Deepfake con le IA: il caso della finta donna afroamericana che accusa Kamala Harris di averla investita

“È successo all’angolo tra Post Street e Jones Street: stavamo attraversando e un’auto è sbucata da dietro un furgone parcheggiato. Post Street è a senso unico, quindi non ci aspettavamo che arrivasse qualcuno da quel lato. Mamma ha reagito rapidamente ed è saltata indietro, mi ha tirata per il braccio ma era troppo tardi: sono stata colpita al fianco e scaraventata sulla strada, sono caduta sul marciapiede e ho sbattuto la schiena. Ricordo che ero sdraiata sul ciglio della strada a guardare la donna che mi aveva investito: era seduta al volante e mi osservava, ho sentito mia madre urlare, poi la donna ha messo in moto la macchina ed è ripartita. Ho cercato di girare la testa e di guardare mia madre, ma il dolore mi ha sopraffatta e sono svenuta”.

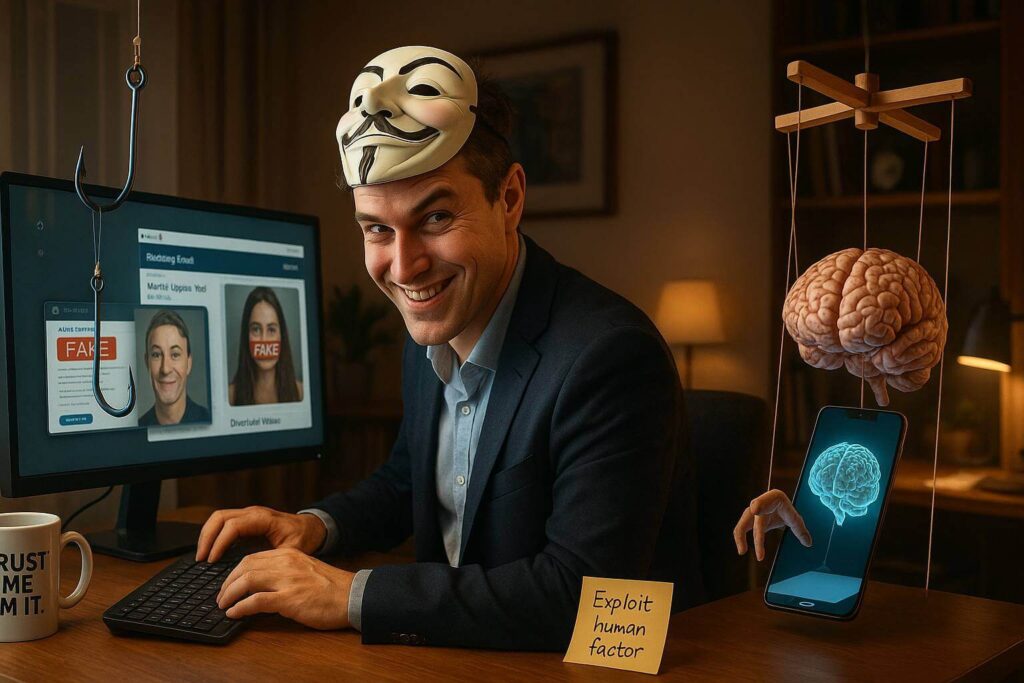

Questo racconto, ricco di dettagli e costruito di proposito per suscitare emozione, empatia e soprattutto indignazione, è stato pubblicato su un finto sito di news legate a San Francisco (è sparito dalla Rete ma ce ne sono tracce sulla Wayback Machine dell’Internet Archive) e parla di un fatto che non è mai avvenuto. Parla di Kamala Harris, oggi candidata dei Democratici alla Casa Bianca e allora procuratore generale della California, che avrebbe investito una ragazzina di 13 anni e poi sarebbe fuggita. La possibile, prossima presidente degli Stati Uniti sarebbe dunque un pirata della strada. Se questa storia fosse vera, cosa che invece non è.

Presidenziali USA

Elon Musk ha condiviso un falso video di Kamala Harris modificato con l’IA

29 Luglio 2024

Per gli esperti è un falso al 97%

La bufala, che online era pure accompagnata da un video di oltre 4 minuti in cui la presunta vittima (che oggi avrebbe 26 anni ed è stata creata con l’intelligenza artificiale) riviveva gli attimi terribili dell’inesistente incidente, è stata pubblicata per la prima volta lo scorso 2 settembre e molto condivisa su Facebook, Reddit, TikTok, Twitter, YouTube e su piattaforme russe come VK, in inglese, francese, russo, tedesco e portoghese. Secondo NewsGuard, che ha raccontato la vicenda, sarebbe stata citata oltre 10mila volte solo su Twitter nelle prime 24 ore.

La finta donna, che è afroamericana evidentemente per fare ancora più male ad Harris dal punto di vista politico, si chiamerebbe Alicia Brown o Alisha Brown (come d’abitudine, le fake news non sono coerenti nemmeno con loro stesse) e se si guarda con attenzione e con calma il video in cui parla si notano chiari problemi: i suoi denti spariscono e riappaiono in alcuni momenti, l’area intorno alla faccia appare sfocata a tratti e il labiale sembra interrompersi e poi ripartire. Secondo TrueMedia, uno strumento utile per individuare i deepfake, ci sarebbe il 97% di probabilità che la voce della donna sia stata totalmente creata o comunque manipolata con l’IA e il 73% di probabilità che il viso della donna sia stato modificato o ricreato con l’IA.

Chi è stato a farlo?

Al momento non c’è alcuna prova che Harris sia stata coinvolta in un incidente stradale del genere nel 2011 e pure la presunta radiografia della ragazzina che viene mostrata nel video sarebbe già comparsa nel 2017 in un paper scientifico che parla di ortopedia infantile. Inoltre, negli Stati Uniti non esiste alcuna testata giornalistica che si chiama KBSF-TV: il sito che ha diffuso la bufala è andato online il 20 agosto ed è stato rimosso da Internet il 4 settembre.

Secondo NewsGuard è difficile risalire al colpevole ma molti indizi portano a un certo John Mark Dougan, un diffusore seriale di fake news scappato in Russia nel 2016 per sfuggire a un’indagine penale negli Stati Uniti, che negli anni ha creato 167 siti di disinformazione, usando spesso video generati con l’intelligenza artificiale per formulare accuse infondate, anche contro altri politici Dem degli Stati Uniti.

Autore del post: La Repubblica Tecnologia Fonte: https://www.repubblica.it/rss/tecnologia/rss2.0.xml Continua la lettura su: https://www.repubblica.it/tecnologia/2024/09/09/news/deepfake_kamala_harris_donald_trump_fake_news_intelligenza_artificiale_alisha_brown-423488092/?rssIl Ministero delle Pari Opportunità finanzia il tuo corso digitale

Chiedi tutte le informazioni a [email protected] |