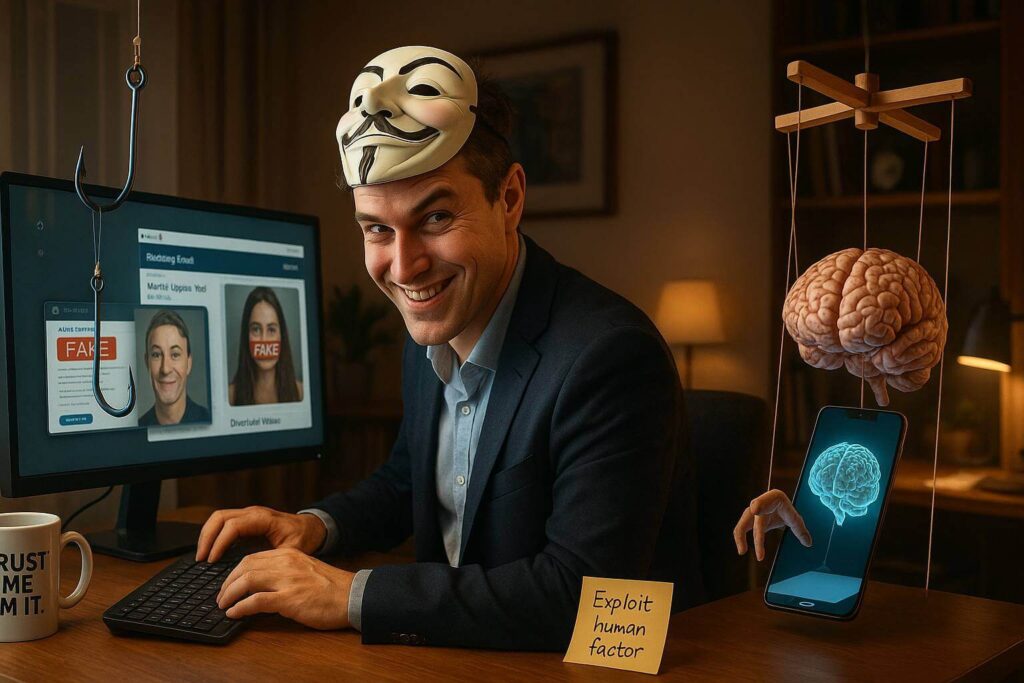

L’allarme deepfake: la democrazia è sotto attacco? Ecco come difendersi

Un recente editoriale di Agenda Digitale lancia un messaggio chiaro: l’intelligenza artificiale generativa – e in particolare i deepfake – rischia di minare la fiducia pubblica, manipolare l’opinione e influenzare le elezioni. L’autore propone la creazione di un’autorità globale anti-deepfake, sul modello di quanto già avviene per il nucleare con l’AIEA o per la salute con l’OMS.

I deepfake non sono più solo un gioco tecnologico: oggi rappresentano una vera minaccia per la democrazia, l’informazione e la sicurezza personale. Video creati con l’Intelligenza Artificiale possono simulare alla perfezione volti e voci, rendendo difficile distinguere tra realtà e finzione. Alcuni Paesi stanno già cercando soluzioni, ma manca ancora un’azione globale coordinata. Con il progetto Genitori Digitali, l’Associazione Koinokalo promuove corsi gratuiti, sportelli di supporto e materiali pratici per aiutare famiglie, docenti e cittadini a riconoscere le truffe digitali e proteggersi.

Perché la minaccia è concreta

Produzione in tempo reale: con software open-source è possibile sostituire volto e voce durante una videochiamata in pochi secondi.

Diffusione virale: clip false possono circolare a milioni di utenti prima che i fact-checker intervengano.

Elezioni 2025-2026 nel mirino: l’ITU (ONU) e il World Economic Forum segnalano una crescita del 40 % dei tentativi di disinformazione audiovisiva in vista delle urne World Economic Forum.

Cosa si sta muovendo nel mondo

| Paese / Organismo | Misura in cantiere o già attiva | Fonti |

|---|---|---|

| ONU – ITU | Standard globali su watermark e filigrane invisibili per video AI | Reuters |

| Danimarca | Diritto d’autore su volto e voce per i cittadini, divieto di deepfake non autorizzati | The Times |

| USA (California) | Defending Democracy from Deepfake Deception Act: obbligo di etichettatura dei video elettorali falsi | White & Case |

| New York State | Stop Deepfakes Act (marzo 2025): metadati obbligatori nei file generati da AI | Reality Defender |

| UK Ofcom | Libro bianco su “attribution & provenance” per piattaforme social | Simmons & Simmons |

Tuttavia, le normative restano frammentate. Da qui la richiesta di un coordinamento sovranazionale: linee guida uniche, sistemi di certificazione dei contenuti e sanzioni condivise.

Riconoscere un deepfake: segnali d’allarme per tutti

Occhi e denti “innaturali” – lampeggi irregolari, riflessi statici, contorni flou.

Voce metallica o monotona – timbro squillante ma privo di micro-pause e inflessioni realistiche.

Sfondo incoerente – oggetti che “tremano”, orecchini sfalsati, luci che non coincidono col volto.

Contesto incredibile – una dichiarazione sensazionale pubblicata solo da un account sconosciuto.

Metadati assenti – file scaricati dai social senza firma, data o fotocamera riconoscibile.

Consigli pratici di Genitori Digitali

All’Associazione Koinokalo APS, con il progetto Genitori Digitali, formiamo famiglie e docenti a riconoscere i falsi digitali:

Corsi gratuiti su fact-checking, watermark e tool per verificare origine e cronologia dei video.

Quiz interattivi per allenare l’occhio ai dettagli “che non tornano”.

Sportello assistenza (telefono e videochat) per segnalare contenuti sospetti e ricevere supporto tecnico.

Hai trovato un video dubbio? Blocca la condivisione, verifica su siti di debunking (Es. Facta, Snopes) e consulta i nostri tutor: insieme trasformiamo la prudenza in abitudine.

Perché il tuo 5×1000 fa la differenza

Scegliendo di destinare il 5×1000 a Koinokalo (CF 95200350635) ci aiuterai a:

aggiornare i laboratori anti-deepfake per scuole e centri anziani;

produrre guide gratuite con le ultime truffe AI e i metodi per difendersi;

potenziare la nostra piattaforma di e-learning accessibile anche a chi ha difficoltà economiche.

Un gesto che non costa nulla, ma moltiplica la sicurezza digitale di tutti.

Visita genitoridigitali.it e seguici su Facebook per webinar, notizie e approfondimenti: restiamo uniti contro le falsificazioni del futuro.